Social-network, il cancro della nostra società

-

Badge Recenti

-

Notizie

-

-

36 Diffusori significativi degli anni ‘70

-

1. Quali tra questi diffusori degli anni '70 ritieni più significativi?

-

Acoustic Research AR-10π

-

Acoustic Research AR-9

-

Allison One

-

B&W DM6

-

BBC LS3/5a

-

Dahlquist DQ10

-

Decibel 360 Modus

-

ESS AM-T 1B

-

IMF TLS 80

-

JBL L300 Summit

-

Jensen Model 15 Serenata

-

KEF 105 Reference

-

Linn Isobarik

-

Magnepan Magneplanar SMG

-

Magnepan Magneplanar Tympani 1

-

Philips RH545 MFB Studio

-

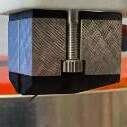

RCF BR40 & BR55

-

Snell Type A

-

Technics SB-10000

-

Yamaha NS-1000M

-

- Si prega di accedere o registrarsi per votare a questo sondaggio.

- Visualizza topic

-

.png.000945b7d3d4995241473f19acefb9d5.png)

.png.a338eb50e2f4c5a50ef570d821cd559f.png)

.png.368e04cdee98f667d57ce4520ee0a8bf.png)

Messaggi raccomandati